摘 要:为了弥补传统朴素贝叶斯分类器在实际应用中代价不敏感的缺点,基于最小风险准则构建朴素贝叶斯模型和树增强朴素贝叶斯网模型,通过预先设置损失矩阵,分类器可以区分各种误判情形产生的代价,利用1 000条德国信用卡样本数据进行实验。研究发现,在以损失最小为导向的用户信用评估方面,基于最小风险准则构建分类器产生的总损失更小,综合性能更好;在分类性能上,简单的朴素贝叶斯模型可与复杂的基于爬山算法建立的贝叶斯网络模型相媲美;从整体经济效益看,朴素贝叶斯模型更胜一筹。

关键词:朴素贝叶斯;树增强朴素贝叶斯网;代价敏感;最小风险准则;爬山算法

DOI:10.11907/rjdk.171519

中图分类号:TP319

文献标识码:A 文章编号:1672-7800(2018)006-0146-04

Abstract:In order to make up for the shortcoming that the traditional Naive Bayes is not sensitive in the practical application, Naive Bayes and Tree augmented naive Bayesian network are established based on the minimum risk criterion. By pre-setting the loss matrix, the classifier can distinguish the costs of various miscarriages.1 000 German credit card samples were used for experiments. Experiment results have shown that the classifier based on the minimum risk criterion produces less total loss and better overall performance in the least-cost-oriented user credit evaluation. In terms of classification performance, the simple Naive Bayesian model can be compared with the complex Bayesian network model based on the hill-climbing algorithm. The Naive Bayes model is superior in the overall economic efficiency.

Key Words:Naive Bayes; tree augmented naive bayesian network; cost sensitive; minimum risk criterion; hill climbing algorithm

0 引言

貝叶斯网络是贝叶斯方法与图形理论的有机结合[1]。1986年Pearl首次在专家系统中引进了贝叶斯网络[2]。贝叶斯网由于在理论上具有严格性和一致性,能直观表达图形化知识等特点,已经成为人工智能领域的研究热点。贝叶斯网的学习包括构建有向无环图的学习、结构学习及每个变量局部条件概率分布的学习即参数学习。贝叶斯网本身是一种不定性因果关联模型,具有强大的不确定性推理能力,利用条件概率表示各变量间的相关性。朴素贝叶斯分类器基于一个简单的假设:在给定分类特征条件下属性值之间条件是相互独立的。在现实世界中,它的属性独立性假设使其无法表示实际应用中各属性之间的依赖关系,影响了分类性能。因此,针对实际应用对朴素贝叶斯分类模型进行改进,使之在属性独立性假设不满足的条件下依然具有较高分类精度。由于“朴素贝叶斯假设”在实际中往往不成立,因此对朴素贝叶斯分类器的改进,一般从放松朴素贝叶斯假设入手,当属性间存在依赖时,采用合适的方法对分类器结构进行修正。隐藏朴素贝叶斯[3]考虑属性间的依赖关系,并采用条件互信息进行计算。树增强朴素贝叶斯(Tree Augmented Naive Bayesian Classifier, TAN分类器)假设在贝叶斯网中,每个属性除了有类别属性作为父节点外,还可以有至多一个其它属性作为父节点,所有属性节点可以构成一个最大支撑树。TAN模型通过发现属性对之间的依赖关系放松朴素贝叶斯中任意属性之间独立的假设[4]。贝叶斯网的结构学习一般需要考虑模型选择和模型优化两个方面[5]。模型选择决定了评判不同模型优劣的准则,而模型优化则是把最优模型结构找出来。1992年Cooper等[6]发现基于爬山搜索算法和贝叶斯评分准则的经典K2算法效果良好;1994年Remeo[7]提出K3算法,使用MDL评分函数进行贝叶斯网络结构学习;1995年Chickering等[8]将模拟退火算法应用于贝叶斯网络结构学习中;Gamez等[9]应用爬山算法进行贝叶斯网络结构学习。本文根据实际应用中的具体情况,通过建立贝叶斯网模型解决信用系统中常见的用户信用评估问题。传统的朴素贝叶斯模型不具有代价敏感特性,这一缺点使得模型输出产生较高的经济损失。考虑代价的分类学习称为代价敏感学习[10]。Maloof[11]提出了处理不平衡数据集中类别误判代价不相等且不确定的解决方案。Elkan[12]详细介绍了代价敏感分类决策的基本概念,并通过实验证实了改变训练正负样本的比例对最终分类效果影响不大。在实际数据挖掘应用中,存在许多在线分类问题,Wang等[13]利用在线梯度下降算法的思想,提出了代价敏感学习在线分类算法。在信用评估中,如果把信用良好的客户误判为信用差的客户固然会使银行损失一笔收益,但如果将原本信用差的客户错判为信用良好,就会造成更大损失。 显然这两种不同的错误判断所造成损失的严重程度是有显著差别的,后者的损失比前者更严重。本文在传统的贝叶斯网模型中加入代价敏感学习,使得最终模型输出产生的总损失有所减小,以提高分类器的综合性能。

1 数据集

本文以德国信用卡数据为例,在R数据分析软件工作环境下进行实证分析。原始数据集中共有1 000个样本、21个变量指标。数据中混有连续数据和离散数据,为了满足软件的输入,对21个变量指标进行处理,包括离散化处理和变量分解处理(性别与婚姻状况变量marital分解为性别sex和婚姻状况marriage两个变量),最后得到22个变量指标。部分变量说明如表1所示。

2 朴素贝叶斯与树增强朴素贝叶斯网算法理论

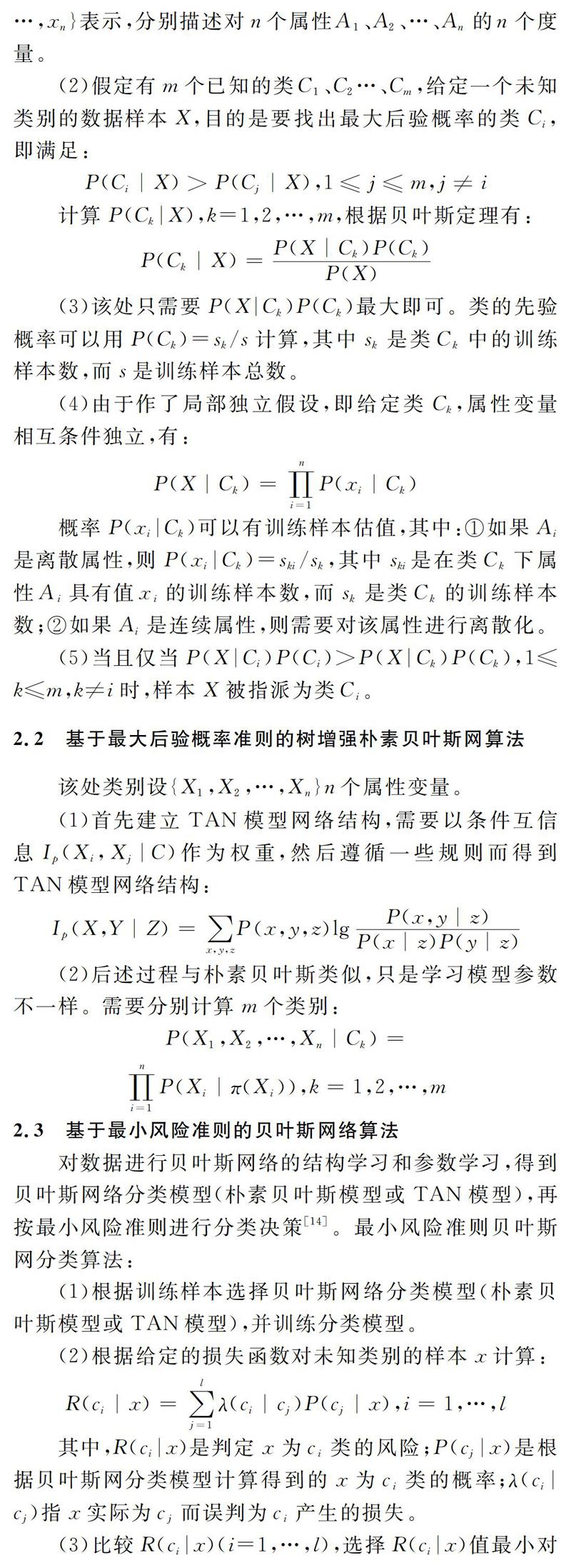

2.1 基于最大后验概率准则的朴素贝叶斯模型算法

3 算法实验与结果

3.1 基于最大后验概率准则的信用评估模型实验

该处类别变量为信用级别变量指标good_bad,可取值为good和bad,分别有700和300个。根据1 000个样本,采用10折交叉检验方法进行计算,最后通过计算10次平均误分率和总损失评价模型性能,其中模型总损失是根据损失矩阵计算出来的。基于最大后验概率准则的损失矩阵:

其中:c-12=1表示把原本信用好的客户判为信用不好的客户,损失1个单位;c-21=1表示把原本为信用不好的客户判为信用好的客户(造成更大损失),损失1个单位。采用10折交叉检验方法,会得到10个混淆矩阵,混淆矩阵的形式为:

其中,a表示类别变量good_bad取值为bad(共有a+c个)时,有a个模型输出为bad,c则表示有c个模型输出为good;b表示类别变量good_bad取值为good(共有b+d个)时,有b个模型输出为good,d则表示有d个模型输出为bad。

最大后验概率准则朴素贝叶斯模型信用评估的效果见表2。

最大后验概率准则TAN模型信用评估效果见表3。

3.2 基于最小风险准则的信用评估模型实验

针对德国信用卡数据,对客户进行分类,由于把原来为“bad”的客户判为“good”,会造成更大损失,于是提出分类风险概念。通过将基于最大后验概率进行分类换为基于最小风险进行分类的方法,使得将原来为“bad”的客户判为“good”的情况减少。此时,损失矩阵:

其中:c-12=1表示把原本为信用好的客户判为信用不好的客户,损失1个单位;c-21=5表示把原本为信用不好的客户判为信用好的客户(造成更大的损失),损失5个单位。不同准则下的朴素贝叶斯与TAN模型的综合信用评估效果对比如表4所示。

加入最小风险准则的概念后,“bad”误分率和总损失明显下降,达到预期效果。根据表格数据可知,朴素贝叶斯模型“bad”误分率从0.480 2降至0.165 9,下降了65.45%,TAN模型“bad”误分率从0.516 2降至0.261 1,下降了49.42%,但代价是增加了“good”误分率与总体误分率。

4 利用爬山算法构建贝叶斯网络模型进行信用评估

基于爬山算法建立的贝叶斯网络结构相比朴素贝叶斯和TAN网络结构更加复杂。有向边连接父节点和子节点,并由父节点指向子节点,表示给定父节点变量取值,子节点变量与网络其它节点变量条件独立。模型选择阶段的评分函数选为AIC[15],并对建立的贝叶斯网络模型进行条件独立性检验,即给定某变量父节点变量,该变量与其它变量独立,确保网络结构的合理性。10组测试部分结果见表5(假设α=0.05)。

根据表5可以发现,变量“property”与“duration”相关性很强,所以需要添加有向边;给定“amount”,“duration”、“property”和“job”具有很强的不独立性,将“amount”指向“duration”的有向边删除。“property”(财产状况)与“duration”(贷款时间)之间的有向边方向,指定由“property”指向“duration”。

基于爬山算法构建的贝叶斯网络模型使用最大似然估计和贝叶斯估计两种参数学习方法,信用评估效果如表6所示。

由表6可知,基于爬山算法、评分函数为AIC建立的贝叶斯模型分类预测结果,与朴素贝叶斯、TAN模型的信用评分效果很接近,同时使用最大似然估计和贝叶斯估计的参数学习方法,其模型评估效果接近一致。

5 結语

通过实际数据,分析了贝叶斯网络中的朴素贝叶斯网和树增强朴素贝叶斯网(TAN)对德国信用卡数据的评估效果,结果显示两种分类器的性能差异不大,分类精度较高,但损失代价较大。在最小风险准则下,评估效果相比最大后验概率准则没有发生明显变化,总损失有所下降,综合性能相对提高。基于爬山算法建立的贝叶斯网络模型评估效果与前两种模型接近,说明简单的朴素贝叶斯模型可以产生更高的经济效益。在此基础上分析了最大似然估计和贝叶斯估计方法的模型评估效果。结果显示,两种参数学习方法的模型评估效果很接近,这是因为数据量足够大,使得贝叶斯估计趋近于最大似然估计。

参考文献:

[1] PAN H P, LIU L. Fuzzy Bayesian networks[J]. International Journal of Pattern Recognition and Artificial Intelligence, 2000,14(7):941-962.

[2] JUDEA P. Probabilistic reasoning in intelligent systems: networks of plausible inference[D]. CA :San Mateo, 1988.

[3] ZHANG H, JIANG L, SU J. Hidden Naive Bayes [C]. National Conference on Artificial Intelligence, 2005:919-924.

[4] FRIED N, GEIGER D, GOLDSZMIDT M. Bayesian network classifiers[J]. Machine Learning, 1997,29(2-3):131-163.

[5] ZHANG L W, GUO H P. Introduction to Bayesian networks[M]. Perking: Science Press, 2006.

[6] COOPER G F, HERSKOVITS E. A Bayesian method for the induction of probabilistic networks from data[J]. Machine Learning, 1992,9(4):309-347.

[7] BOUCKAERT R R. A stratified simulation scheme for inference in Bayesian Belief[C].Proceedings of the Tenth Conference on Uncertainty in Artificial Intelligence, 1994:110-117.

[8] CHICKERING D, GEIGER D, HECKERMAN D. Learning Bayesian networks: search methods and experimental results[C]. Proceedings of the 5th Conference on Artificial Intelligence and Statistics, 1995:112-128.

[9] GAMEZ J A, MATEO J L, PUERTA J M. Learning Bayesian networks by hill climbing: efficient methods based on progressive restriction of the neighborhood[J]. Data Mining and Knowledge Discovery, 2011,22:106-148.

[10] TURNEY P D. Types of cost in inductive concept learning[J]. In Proceedings of Workshop on Cost-Sensitive Learning at the 17th International Conference on Machine Learning, 2002:15-21.

[11] MALOOF M A. Learning when data sets are imbalanced and when costs are unequal and unknown[C]. Washington, DC: In Proceedings of the ICML′03 Workshop on Learning from Imbalanced Data Sets, 2003.

[12] ELKAN C. The foundations of cost-sensitive learning[C]. Seventeenth International Joint Conference on Artificial Intelligence,2001:973-978.

[13] WANG J, ZHAO P, HOI S C H. Cost-sensitive online classification[J]. IEEE Transactions on Knowledge and Data Engineering, 2014,26(10):2425-2438.

[14] 茆詩松.贝叶斯统计[M].北京:中国统计出版社,1999.

[15] 何德琳.贝叶斯网络结构学习算法改进研究[D].北京:北京化工大学,2008.

(责任编辑:何 丽)

- 物理模型教学法在高中生物教学中应用的效果评价

- 小学语文情境识字教学策略研究

- 新时代优秀传统文化助推高校文化建设途径探索

- 翻转课堂在高等数学教学中的应用

- 大学生考研焦虑调查研究

- 论语篇词汇衔接在大学英语精读教学中的应用

- 从城镇低龄老年人就业分析老年人口红利的利用

- 提高医院人事管理效率促进医院经济发展

- 贵州茶产业的发展与生态环保研究

- 中小型农业企业发展问题及解决措施

- 精益管理助力提升项目盈利能力

- 地铁司机职业紧张原因探析

- 对路桥施工企业思想政治工作的探究

- 浅谈企业办公室文秘工作质量和水平优化策略

- 医院医用耗材应用SPD物流管理服务模式的效果评价探究

- 国有企业社保工作面临的问题与对策

- 浅析加密资产的会计识别问题

- 浅析新媒体营销的主要模式及主要问题

- 西部地区生鲜农产品物流水平评价和发展模式选择

- 浅析石化企业青年人才队伍建设存在问题和培养措施

- 激励机制在医院人力资源管理中的应用

- 医院医疗设备固定资产管理问题及对策探究

- 浅析中小企业绩效考核管理存在的问题及对策研究

- 国有企业员工退出管理机制的优化研究

- 工程造价风险管理及控制要点分析

- jerkily

- jerkiness

- jerkiness'

- jerkinesses

- jerkinesses'

- jerkiness's

- jerking

- jerkingly

- jerking-off

- jerk's

- jerks

- jerky

- jerky's

- jerk²

- jerk¹

- jersey

- jerseyan

- jerseyans

- jerseyed

- jerseyite

- jerseyites

- jerseys

- jest

- jested

- jester

- 耐力

- 耐劳

- 耐叨

- 耐头

- 耐子

- 耐官心

- 耐实

- 耐寒

- 耐得住

- 耐得寂寞

- 耐得心头气,方为有志人

- 耐心

- 耐心地等待

- 耐心安之,以俟知者

- 耐心 急躁

- 耐心烦儿

- 耐心的人们赢得胜利

- 耐心耐意

- 耐心耐肠

- 耐性

- 耐性儿

- 耐惊耐怕

- 耐惊耐怕的虫蚁儿

- 耐战

- 耐普尔