荷兰开放大学的大数据多模态学习分析研究新进展

张楠

● 引言

人们今天已经熟知大数据具有4V属性,其中一个属性就是数据的半结构化和非结构化,因此解决这一领域问题的多模态数据分析研究越来越受到人们的关注。荷兰开放大学维尔滕学院的丹尼尔·迪米特里博士一直致力于研究学习分析和人工智能。维尔滕学院是荷兰开放大学的学习、教学和技术研究中心,该研究中心以科学的、高质量的、实践性的教育研究为核心,以提高教育质量为目标(该目标有助于弥合理论与实践之间的鸿沟),成为(高等)教育的合作伙伴,成为(国际)国家级高质量研究机构。丹尼尔·迪米特里博士及其他几名相关研究人员利用多模态数据对实验进行了文献调查,构建了多模态学习分析这一新兴研究领域,介绍了用于多模态学习分析领域文献调查的分类框架、有关学习的多模态数据的分类,以及多模态学习分析模型。● 多模态学习分类框架

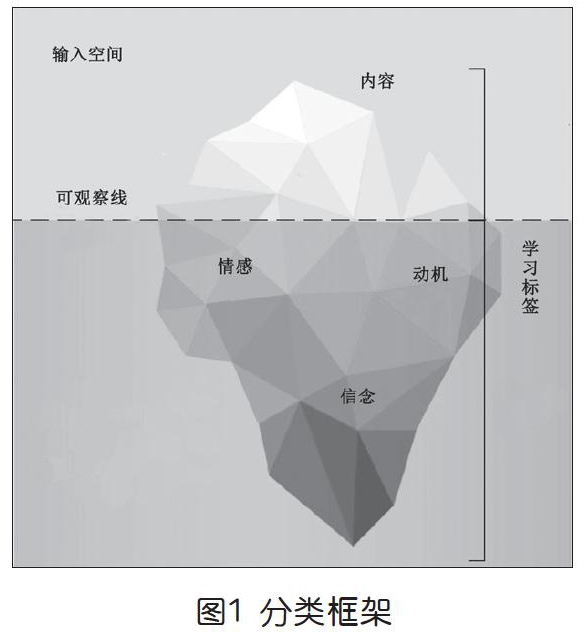

在学习过程中,学习者的行为属性等是能够通过传感器直接观察和测量的,但学习者的认知、情绪这些潜在的属性,无法直接由传感器测量,只能对其推断,一些文献调查将这些方面命名为输入空间和假设空间(如图1)。在人类学习中,输入空间包括学习者的行为和学习情境,这方面的数据虽然可以被传感器自动捕获,但传感器无法对这些数据作出解释或赋予其意义。假设空间包含了一系列可能的解释,即传感器虽然不能直接观察到属性,但也可以利用数据显示。假设空间包括对多模态数据的语义解释,而这些数据是基于心理和学习相关的结构,如情绪、信念、动机、认知或学习结果,其属性属于学习者的意义形成过程,在课堂活动中,教育者和研究人员是看不到这一过程的。

输入空间和假设空间在概念上由可观察线分隔开,从一个通用传感器的角度来看,“水线以上”的部分是显而易见的,“水线以下”的属性需要多层次解释,同时还取决于属性与可观察线的距离有多深。另外,可观察与不可观察之间的区别是概念性的,在实践中可能会有所不同。● 用于学习的多模态数据的分类

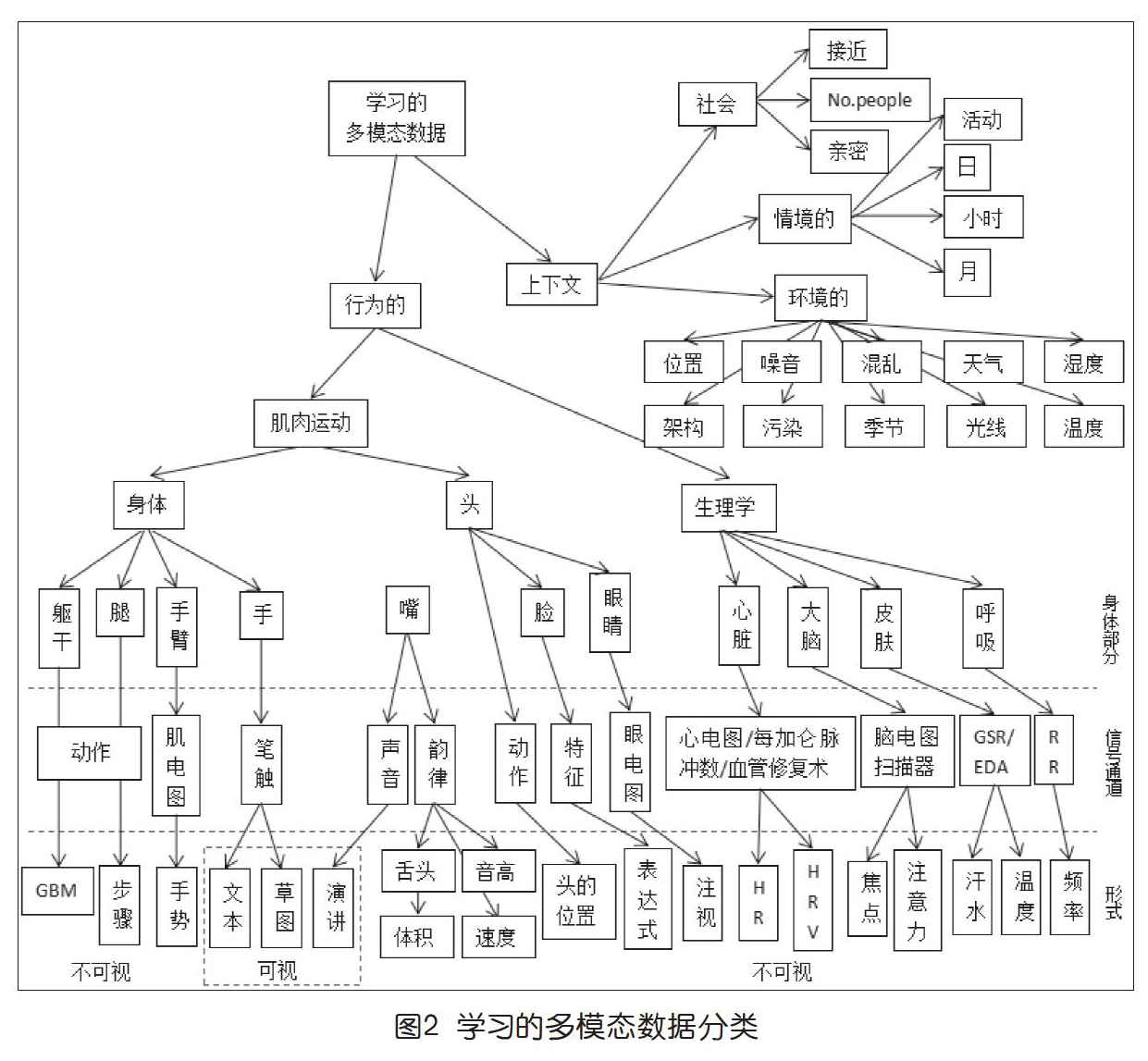

多模态学习数据分类是组织可观测模态(输入空间)复杂性的第一种方法,可由传感器监测,并在调查研究中被提及。这种分类并不是对学习模式的详尽分类,也不是对不同传感器类型的技术审查。对于后者,我们参考Schneider等人的综述,该综述提供了可应用于教育领域的传感器的广泛列表。

综述从通用传感器的角度给出了分类方法(如图2),其基本思想是传感器可以监视一个(或多个)模态。在这里,我们将情态作为一种可测量的属性,属于身体或上下文的特定部分。模态通过信号通道进行通信,信号通道连续采样导致一个(或多个)模态的纵向收集。例如,麦克风(传感器)可以采样语音(通道)来检测语音(模态),或者摄像机可以同时跟踪语音、动作和面部特征,从而提供语音、全身运动(GBMs)和面部表情。为了概述所提出的分类,我们分析了两个主要的分支:行为运动模态和行为生理学模态。

运动模态可分为与“身体”或“头”有关的模态,其中身体包括躯干、腿、手臂和手。来自摄像机的躯干的运动可以提供GBM,而腿的运动可以通过步数来跟踪,并为身体活动提供良好的指标,手臂和手则是更有意义的身体部位,其运动也可以被摄像机检测到,在这种情况下,一种流行的选择是Microsoft Kinect用于手势和身体姿势的识别,尤其是那些注重表达技巧的研究选择了这种解决方案。另一种选择是可以用肌电图传感器(EMG)跟踪手臂运动和手势。最后,手作为身体的一部分,可以提供对学习者活动的最好的洞察。

头部运动模式包括面部表情分析、眼球运动和语言分析。在情感计算研究中,面部表情在情感识别学习中被高度研究,也在多模态人机交互实验中得到了广泛应用。眼动跟踪通常被用作学习者注意力的指标,也被用于多模态数据集。而语音的分析的范围是从副语言分析(如说话时间、发音关键字或韵律特征)到学生与教师互动等对话环境中口语单词的实际识别。

生理形态也可分为相应的身体部位,心脏、大脑和皮肤是获得生理信息的主要器官。目前,较为流行的检测大脑活动的方法是脑电图(EEG),它可以测量大脑内部电位的差异。Prietoetal将EEG与眼动跟踪相结合,进而从教师分析的角度预测互动的社会层面和具体的教学活动。心脏活动的测量则可以采用不同的技术来计算,如心率和HRV——心电图(ECG)或光容积描记术。皮肤电反应(GSR),也称为皮肤电活动(EDA),用来测量皮肤电导率。另外,如果身体受到生理上的刺激,皮肤电导就会增加。● 假设空间分类表

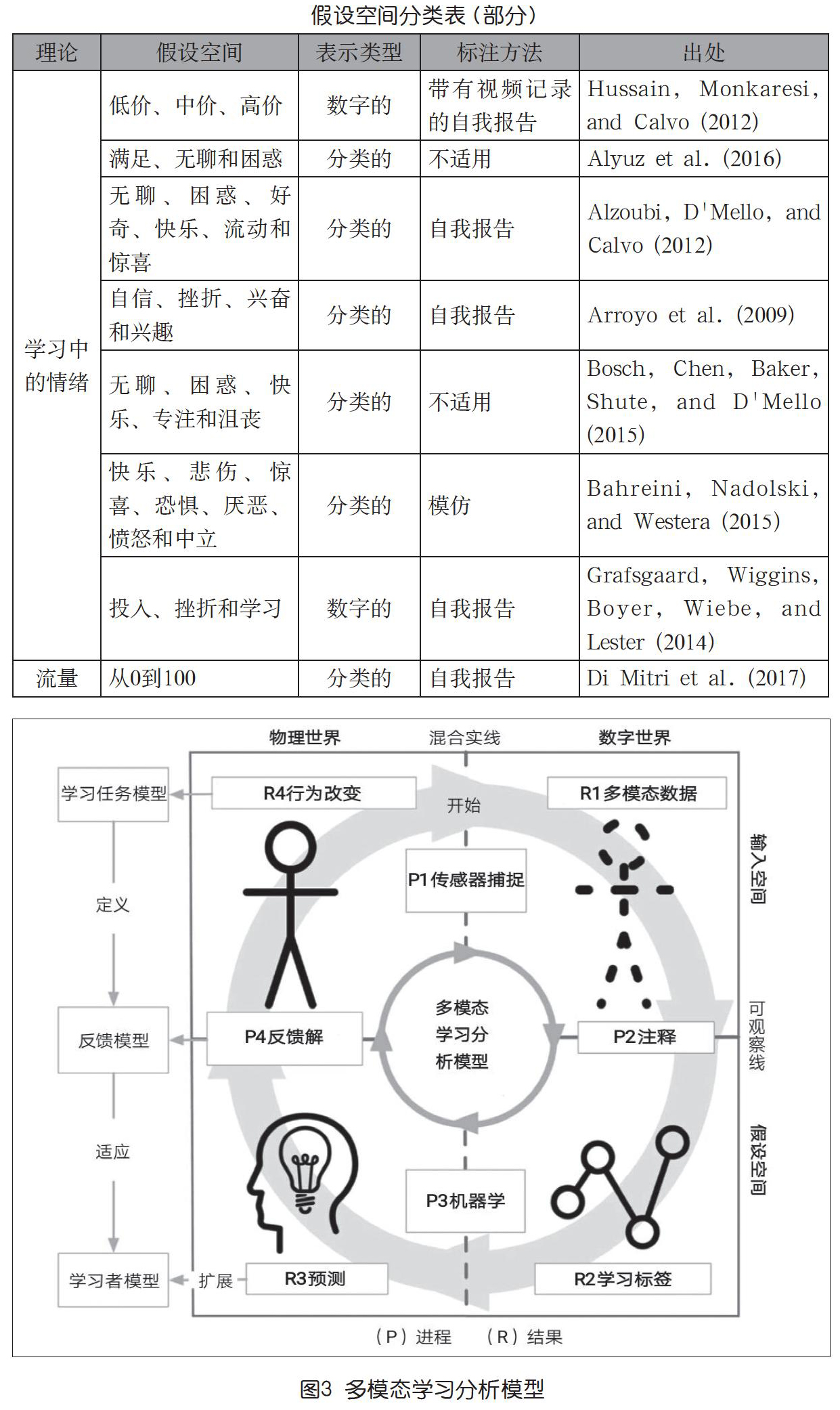

下页表总结了在选择的使用多模态数据的研究中发现的学习理论。该表根据所选择的理论结构、假设空间规范、数据表示类型和标注方法对研究进行分类,为研究提供参考。

使用多模态数据的最先进的研究侧重于预测情绪。情绪被認为是身体生理变化的表现,随着对特定刺激的反应而变化。根据体细胞标记假说,生理变化发生在身体中,当它们被解释为情绪时,会传递给大脑,进而人们通过自主神经系统反应来适应环境和情感刺激。因此,情绪被认为在学习中具有重要的作用,学习过程中典型的情绪是困惑、无聊、投入、好奇、兴趣、惊喜、喜悦、焦虑和挫折。

心流是一种运行的心理状态,当个人沉浸在精力充沛的专注、享受和充分参与当前活动的状态中时,就会体验到这种状态。它是由内在动机而不是外在奖励来满足,当任务的难度和个人对给定活动的准备程度达到平衡时,这种流动就会自然发生。

● 多模态学习分析模型

多模态数据分析模型(MLeAM)引入了第二个正交维——混合实线。混合现实被定义为物理世界和数字世界相遇的连续空间。我们相信物理世界和数字世界的分离有助于理解智能计算机代理和数字技术给学习过程带来的好处。学习者的行为和反馈传递发生在物理世界,而模态的多模态数据表示及其处理和注释发生在数字世界。综述中,可观测线和混合实线之间的交集创建了四个象限(如图3)。这些象限之间的转换由生成结果的过程“P”指导。模型从顶部中心开始按顺时针方向迭代。

1.从传感器采集到多模态数据

模型从(P1)传感器捕获开始,即自动采样传感器从几个模式中获得记录数据,其选择的模式与输入空间的属性有关,如学习者的身体位置、注视方向和面部表情,且这些数据可以从学习者的行为和活动或学习环境中提取,无论哪种情况,模式都存在于物质世界中。P1不断地将不同的模态转换为它们的数字表示,即(R1)多模态数据的多形式数据流。多模态数据流的截线对应于学习者在特定时间点的学习上下文中的数字快照。在设计P1实现时,有三个重要方面需要考虑:第一,使用的输入空间的定义——模式的启发式选择及其数据表示;第二,确定最适当的传感器,以便为具体的学习方案捕捉选定的模式;第三,传感器体系结构的设计和实现,用于从多个传感器收集和序列化数据流的硬件和软件基础设施。传感器体系结构的设计必须考虑几个技术方面,包括传感器网络工程、原始数据同步、融合技术和用于传感器数据持久性的数据存储逻辑。

2.从注释到学习标签

第二个过程是(P2)注释,这是一个由专家或学习者人为驱动的重复过程。P2的目标是根据一些预定义的评估方案,用人类的判断来丰富低语义多模态数据。该方案基于假设空间,即机器学习算法自动从多模态数据中推导出的不可观测的解释。P2可以被看作是一个学习任务与一些学习目标之间的评估,并通过三角剖分实现,即“法官”首先接触到一些关于学习任务的人类可解释的证据(如视频或直接观察),接着将一些(R2)学习标签分配给多模态数据的时间段。这个过程P2允许为原始数据的某个时间间隔提供一些意义。与P1类似,P2需要定义所有可能的学习标签,该任务对应于定义假设空间及其数据表示,同时,它还需要设计由报告工具和注释过程组成的注释策略。

3.从机器学习到预测

第三个过程是(P3)机器学习。监督机器学习的目的是从观察到的(R1)多模态数据和手工标注的(R2)学习标签中学习统计模型(函数);对未来未观察到的数据进行归纳,生成类似结构的(R3)预测。核心的机器学习任务可以用数学形式表达,计算一个函数:y=f(X)+ε。

X为多模态观测,输入函数f。 X为n个属性向量,由多种学习模式导出,X的所有可能的值组合构成了输入空间,即f的定义域。

y是学习标签(s),它将每个输入的观察结果定位到假设空间,即所有可能学习标签的f的范围。

函数f是一个泛化的关系,观察X和y+学习标签一些误差项ε。

给出一种新的多通道观测Xnew,预测计算学习任务对应的标签(s)ynew=f(Xnew)+ε。

P3还包括以下迭代步骤:①预处理——重采样,处理丢失的数据,使模型符合数据;②后期处理——选择相关属性,调整参数,验证模型对新数据的通用性;③诊断——获得相关性,以确定每个属性在预测学习标签方面的重要性。如果对所得到的模型进行合理的精度训练,系统能够在不可见的多模态数据中预测学习标签。这个预测是一个机器辅助估计学习者在学习过程中的立场。P3使用机器将必须由人类驱动的注释过程自动化。预测可以用来丰富学习者模型,为学习者提供更具适应性的反馈模型,并推动他们走向积极的行为改变。

4.从反馈解释到行为改变

最后一个过程是(P4)反馈解释,关闭返回给学习者的由机器驱动的反馈回路。P4的目的是利用对多模态数据的支持,并导致R4行為变化。P4需要预先设计好反馈模型,反馈模型高度依赖于学习活动,并由任务模型定义。MLeAM不处理任何反馈维度,也不提供依赖于学习活动的有效反馈策略。尽管如此,MLeAM可以与不同的反馈模型结合使用,并结合已经分析过的有关学习者行为和上下文的相关信息。另外,根据通过MLeAM得到的预测,学习者还可以得到不同形式的反馈,且反馈设计应能够促进反馈解释的过程,引导学习者产生新的学习行为。

本文受到东北师范大学教师教育研究基金重点课题“基于数据挖掘的教师专业发展成长轨迹研究”,吉林省教育厅“十三五”社会科学研究规划项目重点课题“基于数据挖掘的卓越教师能力结构与培训研究”及政府委托项目“长春市二道区集优化办学UGS合作模式服务项目”资助。